Sprachassistenten und Datenschutz Amazon lässt Alexa-Mitschnitte im Homeoffice auswerten

In der Debatte um die Auswertung von Nutzerdaten aus Sprachassistenten ist Amazons Dienst Alexa erneut in den Fokus geraten. Laut einem Bericht der „Welt am Sonntag“ sollen befristete Angestellte teilweise von zu Hause aus Daten aus Amazons Sprachassistentin Alexa auswerten.

Anbieter zum Thema

In den vergangenen Wochen hatte es zunehmend Kritik an Amazon gegeben, dass sich auch Menschen aufgezeichnete Fragmente von Unterhaltungen der Nutzer mit dem digitalen Sprachassistenten Alexa anhören und abtippen, um die Spracherkennung zu verbessern. Die jahrelange Praxis war den Nutzern bis vor wenigen Monaten weitestgehend unbekannt. Laut einem Bericht der „Welt am Sonntag“ sollen sogar befristete Angestellte teilweise von zu Hause aus Daten aus Amazons Sprachassistentin Alexa auswerten. „Einigen Mitarbeitern ist es gestattet, von anderen Orten aus zu arbeiten“, erklärte Amazon dazu. „Dabei gelten strenge Sicherheitsmaßnahmen und Richtlinien, an die sich jeder Mitarbeiter halten muss.“ Es sei auch eindeutig festgelegt, „dass Mitarbeiter niemals an öffentlichen oder nicht-autorisierten Orten arbeiten dürfen“.

:quality(80)/images.vogel.de/vogelonline/bdb/1551100/1551123/original.jpg)

Menschliche Lauscher und HIPAA-konforme Umgebung

Alexa, hör mal bitte weg!

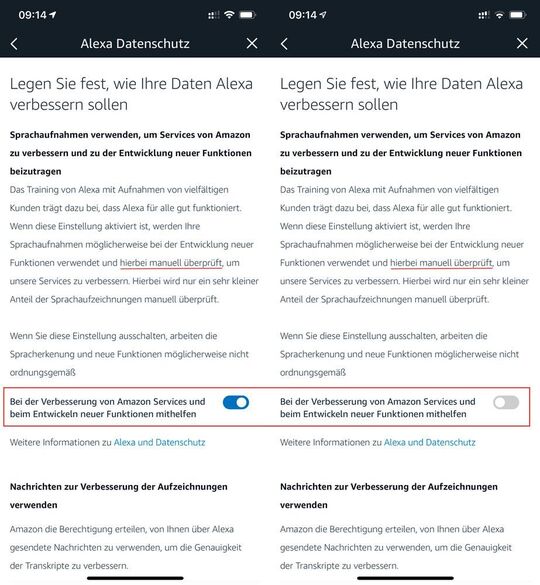

Seit diesem Wochenende bietet Amazon Alexa-Nutzern, die sich um ihre Daten sorgen, eine neue Option an: Sie können die Auswertung von Mitschnitten durch Mitarbeiter des Konzerns verhindern. In der Alexa-App findet sich nun ein Schalter dafür. Die Alexa-App weis die Nutzer in einem Punkt in den Datenschutz-Einstellungen jetzt auch erstmals ausdrücklich darauf hin, die Sprachaufnahmen werden „möglicherweise bei der Entwicklung neuer Funktionen verwendet und hierbei manuell überprüft, um unsere Services zu verbessern“. Davon sei nur ein „sehr kleiner Anteil“ der Mitschnitte betroffen. Über dem Software-Schalter, der das ablehnt, platzierte Amazon einen Warnhinweis, dass das Ausschalten möglicherweise Funktionen einschränkt.

In Polen bewarb ein Zeitarbeits-Dienstleister die Jobs zur Auswertung von Alexa-Aufnahmen in inzwischen gelöschten Anzeigen der „Welt am Sonntag“ zufolge als „Telearbeit im ganzen Land“. Ein Zeitarbeiter sagte dem Blatt, er und viele seiner Kollegen arbeiteten vom Küchentisch aus. Amazon betonte: „Der Zugang zu internen Systemen wird streng kontrolliert und wir verfolgen eine Null-Toleranz-Politik wenn unsere Prozesse nicht befolgt werden.“ Alle Mitarbeiter nutzten „sichere, proprietäre Tools, um Alexa zu verbessern“.

Dass Fragmente von Alexa-Aufnahmen auch von Menschen ausgewertet werden, war im Frühjahr durch einen Bericht des Finanzdienstes Bloomberg bekanntgeworden. Damals ging es um das Anhören der Aufnahmen bei einem Dienstleister in Rumänien.

Schnell kam heraus, dass dies auch bei den beiden anderen vielgenutzten Sprachassistenten - Apples Siri und dem Google Assistant - der Fall ist. Bei Apple gab es zumindest einen Hinweis auf solche Transkriptionen in einem Sicherheitsdokument für Entwickler. Keiner der Anbieter wies aber bei der Einrichtung der Assistenten ausdrücklich darauf hin, dass auch ihre Mitarbeiter oder Dienstleister die Aufnahmen zu hören bekommen könnten.

Anfang Juli kam eine neue Welle der Kritik, nachdem Mitschnitte vom Google Assistant aus den Niederlanden geleakt wurden. Das veranlasste den Hamburger Datenschützer Johannes Caspar, ein Verwaltungsverfahren gegen Google einzuleiten. Der Internet-Konzern setzte bereits Anfang Juli die Auswertung der Aufnahmen durch Menschen weltweit aus - wie allerdings erst jetzt bekannt wurde. Apple folgte mit einem weltweiten Stopp am vergangenen Freitag - und versprach zudem, die Nutzer ausdrücklich um eine Erlaubnis zum nachträglichen Anhören von Mitschnitten durch Mitarbeiter zu fragen. Die Funktion solle in einem späteren Software-Update umgesetzt werden, hieß es.

:quality(80)/images.vogel.de/vogelonline/bdb/1442700/1442712/original.jpg)

Alexa, Siri und Cortana im Unternehmen

Nutzen und Risiko von Sprachassistenten

Sprachassistenz-Software wie Alexa oder Siri reagiert auf Sprachbefehle des Nutzers. Ein Beispiel: Auf „Alexa, wie spät ist es?“ antwortet der Assistent mit der Uhrzeit. Die Alexa-Software wird vor allem auf den Echo-Lautsprechern des Konzerns genutzt. Amazon arbeitet aber - genau wie Google bei seinem Assistant - daran, sie in möglichst vielen Geräten verschiedener Hersteller unterzubringen. Siri kann man nur auf Apple-Geräten aufrufen.

Die Assistenten starten die Aufzeichnung grundsätzlich erst, wenn sie das Aktivierungswort - „Hey, Google“, „Alexa“ oder „Hey, Siri“ - hören. Allerdings müssen die Mikrofone ständig aktiv sein, um das Weckwort nicht zu verpassen.

Die fehlerhaften Aktivierungen, bei denen die Software glaubt, ihr Weckwort gehört zu haben, sind dabei ein besonderes Problem. Denn dabei können Sätze und Unterhaltungen aufgezeichnet werden, die nicht an die Sprachassistentin gerichtet waren. Beim nachträglichen Anhören sollen die Mitarbeiter auch herausfinden, welche Worte oder Geräusche die versehentliche Aktivierung auslösten, um die Software entsprechend anzupassen. Laut Google werden rund 0,2 Prozent der Aufzeichnungen nachträglich angehört, Apple und Amazon zufolge sind es weniger als ein Prozent.

(ID:46062760)

:quality(80)/p7i.vogel.de/wcms/77/96/77965e389847a783a89d16ec537bbdfd/0127091202v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8a/d7/8ad77a356a43b3c02e85ce72e1f6c2c3/0127092578v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d7/14/d714ac0a936f45496f02ffb57415bef2/0127092564v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/19/4f/194f7a7aacc5be512137e9903e7b9393/0130719515v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/2b/f42b0456ab068cdc722e6cefd4c30479/0130824019v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/d2/b4/d2b43b2301a8e26f7bcd93dea6c10d2d/0130920718v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/72/0f/720f44c6f32c075c10150af5cefc2088/0130871034v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/bf/60/bf604ad872c9e4887eec60dee99084b7/0130783434v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ea/5f/ea5f68b1c97e92c39f3bcffe754ac9ee/0130786498v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/dc/56/dc56436ba821e4c90c9aecf053517801/0130379749v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/62/1662fe93b01eea7699de460e62dfe9a6/0130736643v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/97/c5/97c5e41a155d082355f34621af2f5791/0130857540v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/25/53/25536c0bb262a7ac94848efaaf7d88d4/0130457223v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/c4/52/c4526444911a1e496bc113813291c6be/0130586130v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/04/e70481da107589efc1fd491106c4eea9/0130685142v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/48/c4/48c497c1fcf45eba3e5e98fd39ba136a/0130783438v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/d2/9d/d29d95716693afcdced3e70f270f8eac/0130686126v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a9/56/a9568e19e71f36272b559071914c8a63/0126593157v1.jpeg)

:quality(80)/images.vogel.de/vogelonline/bdb/1804200/1804272/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1804200/1804284/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1801500/1801554/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1801500/1801534/original.jpg)

:fill(fff,0)/p7i.vogel.de/companies/63/db/63dbd1915b7af/2023-fastlta-logo-square-positive.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/67/f6/67f625705f340/ftapi-logo.jpeg)

:quality(80)/p7i.vogel.de/wcms/13/f0/13f0136231e0e13dff2e5f37cdea1e4f/0122540263v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/85/64/8564a8af5f8d3eddada95d651475d651/0130869867v2.jpeg)