Data poisoning und KI Künstliche Intelligenz ist angreifbar

KI gilt als treibende Kraft der digitalen Transformation, die in wenigen Jahren alle Bereiche der Gesellschaft durchdringen soll. Mit der Sicherheit der KI steht es allerdings nicht zum Besten. Das zeigt ein von Deutschland und Frankreich erstellter Sicherheitsbericht. Sowohl der Dateninput als auch die Datenbasis des Deep Learnings sind verwundbar sagen Experten.

Anbieter zum Thema

Künstliche Intelligenz (KI) ist aus dem Alltag immer weniger wegzudenken. Schon heute gibt es eine Vielzahl Anwendungen. Versicherungen bestimmen ihre Tarife über KI und Banken entscheiden über Aktienkäufe und -verkäufe. Die Polizei nutzt die “vorhersagende Analyse” (Predictive Analytics) um zu bewerten, in welchen Regionen Einbrüche wahrscheinlich sind. KI soll autonomes fahren von PKW und LKW ermöglichen, und sogar Flugzeuge steuern. Doch mit der Sicherheit steht es nicht zum Besten, das ist die Quintessenz eines von Deutschland und Frankreich erstellten Sicherheitsberichts.

In der Studie "Deutsch-französisches IT-Sicherheitslagebild — 2. Edition" vom Mai 2019 warnen das deutsche Bundesamt für Sicherheit in der Informationstechnik (BSI) und das französische ANSSI (Agence nationale de la sécurité des systèmes d'information ; deutsch Nationale Agentur für Sicherheit der Informationssysteme) vor den Gefahren absichtlich herbeigeführter Fehlentscheidungen mit Hilfe der Künstlichen Intelligenz. Sowohl der Dateninput als auch die Datenbasis des Deep Learnings sind verwundbar, das bekräftigten bei der Vorstellung der Chef des BSI Arne Schönbohm, und sein französischer Kollege, ANSSI-Generaldirektor Guillaume Poupard. Das Resümee der Experten klingt nicht beruhigend: ähnlich wie bei Malware droht auch hier ein Katz- und Mausspiel zwischen Angreifern und Verteidigern. Aktuell haben die Angreifer eindeutig die Nase vorn. "Trotz der großen Fähigkeit neuronaler Netze Generalisierungen zu erzielen, kann das Verhalten der Neuronalen Netze in neuen, seltenen Situationen, nicht vorhergesehen werden. Dies kann als Verlässlichkeitsproblem interpretiert werden", so die Autoren der deutsch-französischen Studie.

:quality(80)/images.vogel.de/vogelonline/bdb/1574400/1574419/original.jpg)

KI in der Cybersecurity

Künstliche Intelligenz – Freund oder Feind?

Vier Jahre hinter den USA - Reaktionen in der EU

Die erste Ausgabe des deutsch-französischen IT-Sicherheitslagebilds stammt wurde im Juli 2018 veröffentlicht. In Frankreich wurde inzwischen das das staatliche Programm „How to secure, certify and make reliable the systems involving AI?“ initiiert. Die Verantwortung trägt ein Programmdirektor, der seit Anfang 2019 direkt dem Premierminister unterstellt ist. In Deutschland veröffentlichte das Bundesministerium für Bildung und Forschung die Richtlinie “Künstliche Intelligenz für IT-Sicherheit”. Das Programm SAFAIR verfolgt denselben Ansatz auf EU-Ebene. Als Basis dient das IT-Sicherheitsnetzwerk SPARTA, das wiederum Teil des Multimilliarden EU-Programms Horizon 2020 ist. Ein Hinweis auf die politische Dimension des Problems. Deutschland und Frankreich sehen Verlässlichkeit und Privatsphäre beim Maschinellen Lernen, sowie verlässliche Architekturen als essentiell für die Rückgewinnung der europäische IT-Souveränität an. Das Engagement darf allerdings nicht darüber hinwegtäuschen, dass es vor allem US-amerikanische Universitäten und Forscher sind, die Fehler und Unzulänglichkeiten der KI offengelegt haben. Seit 2014 publizieren Forscher renommierter Universitäten zusammen mit Experten von Internetriesen ein Paper nach dem anderen.

Motiviert wurden die Forschungsarbeiten durch den Boom bei autonom fahrenden Autos, aber auch medizinische Befunde werden zunehmend durch KI-Systeme analysiert In beiden Anwendungsfällen können Fehlinterpretationen direkt zu Personenschäden führen.

"Für Menschen ist es sehr schwer sich vorzustellen, wie Roboter die Welt sehen", fasste 2017 die renommierte US-Ingenieursvereinigung IEEE die Forschungsergebnisse zusammen , "das menschliche Gehirn und die Algorithmen der Künstlichen Intelligenz arbeiten gänzlich verschieden." Die Universitäten Cornell, Washington, Michigan, Stony Brook University, und die University of California Berkeley veröffentlichten seit 2014 zusammen mit Internetgiganten wie Google Forschungsergebnisse rund um die Fehlbarkeit von Künstlicher Intelligenz. Oft genügt bereits ein kleiner Eingriff, und die ein soeben sicher erkanntes Objekt wird falsch zugeordnet. Nach einem winzigen Eingriff in die Textur einer künstlichen Schildkröte wurde diese als Gewehr (!) erkannt. (Siehe: Fooling Neuronal Networks)

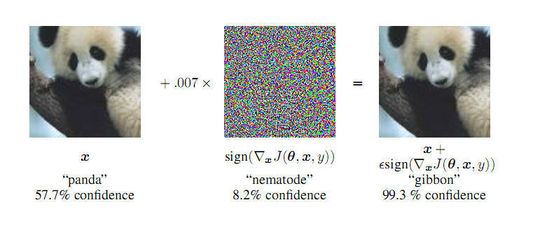

Ein Pandabär wird während eines anderen Experimentes plötzlich als Affe wahrgenommen. Dieses Beispiel fand sogar Eingang in die Deutsch-Französische Studie. In beiden Fällen spielen geeignet gewählte Muster die entscheidende Rolle. Sie verwirren die Bilderkennung, die nur auf die Wahrnehmung ganz spezieller Bildattribute trainiert ist. Welche das sind, wissen oft selbst die Verantwortlichen nicht. Auch für sie ist die Millionen von Parametern umfassende Wissensbasis eines Deep Learning Systems eine Blackbox. So mancher Erfolg eines Neuronalen Netzwerkes, stellt sich später heraus, ist gar keiner. So wurde ein Netz auf die Unterscheidung von Huskies und Wölfen trainiert. Mit großem Erfolg und hoher Erkennungsrate. Erst bei einer zweiten Untersuchung stellte sich heraus, dass die Abbildung von Schnee im Hintergrund maßgeblich den Erfolg beeinflusste. Das Netz hatte gelernt, aber nicht das, was es eigentlich lernen sollte. Das Risiko, unabsichtlich etwas zu lernen, was nicht beabsichtigt war, ist ständig gegeben. Weit schwerer wiegt aber die gezielte Kompromittierung von Daten. So wurde gezeigt, das man die KI darauf trainieren kann, unberechtigten Personen Zugang zur IT zu gewähren. Solche Backdoors sind in der IT nichts Neues, aber hier verstecken sie sich innerhalb von Millionen gelernter Beispiele und sind so bis heute nicht zu entdecken. Das Netz öffnet die Backdoor erst, wenn ein vorher erlernter Schlüsselreiz wahrgenommen wird.

Vergiftete Daten, "data poisoning", gilt als neue Bedrohung. Die Sicherheitsbehörden fordern daher sichere Lieferketten für KI-Trainingsdaten. Ohne Trainingsdaten funktioniert kein KI-System. Da sehr viele Daten benötigt werden, ist es für den einzelnen Kunden kaum möglich, sein KI-System vollständig in Eigenregie zu trainieren. Die Studie fordert daher Transparenz und Nachvollziehbarkeit bei der Herkunft der Trainingsdaten und beim Resultat. Hier müssen wohl weltweit noch alle Hersteller passen, denn sie liefern ihre Neuronalen Netze meist als Blackbox aus. Unterstützung erhalten hier die Sicherheitsbehörden von den Deutschen Datenschutzbeauftragten, auch sie möchten das erlernte Wissen der KI-Systeme überprüfen können. Das Recht dazu schöpfen sie aus der Europäischen Datenschutzgrundverordnung DSGVO).

Die Autoren wenden sich auch gegen die Nutzung von Entwicklerplattformen wie Github, denn hier können viele Teilnehmer in offene Lieferketten eingreifen. Dies könnte nach Meinung der Experten zu Sicherheitsproblemen führen. Die Studie führt als weiteres Beispiel das kontinuierliche Training von Neuronalen Netzwerken an. Dies ist zwar unbedingt nötig, um flexibel auf Änderungen reagieren zu können, und bereits erkannte Sicherheitsschwachstellen zu bekämpfen. Eine permanente Nutzerinteraktionenbietet aber auch Risiken für die KI, ausgehend von mit KI gesteuerten Chat-Bots. Diese könnten die Eingabedaten manipulieren, um damit schädliche Inhalte zu generieren. BSI und ANSSI fordern statt der von der Industrie bislang bevorzugten offenen Lieferketten transparente Lösungen. Sowohl Herkunft als auch Wirkung der Trainingsdaten sollten Nachvollziehbar sein.

:quality(80)/images.vogel.de/vogelonline/bdb/1573500/1573520/original.jpg)

Künstliche Intelligenz im Sicherheitskontext

Was echte KI-Security von Katzenbildern lernen kann

Neue Risiken durch unüberwachtes Lernen

Datenschützer und BSI sind aus diesem Grund auch kein Freund des aktuellen KI-Trendthemas Generative Adversarial Networks (GAN). Bei diesem Verfahren werden zwei Neuronale Netze gegeneinander gesetzt, um sich selbst zu optimieren. Das Verfahren ermöglicht unüberwachtes Lernen, und ist so aus Sicht des Datenschutzes bereits diskreditiert. Die erstmals 2014 vorgestellten GANs bestehen aus einem Generator und einem Diskriminator. Der eine nutzt seine Trainingsdaten, um Kandidaten zu erzeugen, der zweite um die zu akzeptieren oder zu verwerfen. Das Verfahren kann dazu genutzt werden, optimale Fälschungen von Identitäten zu erstellen, aber auch Kunstfälschungen. die nach allen bekannten Kriterien als "echt" gelten. GANs haben laut der Studie zudem das Potenzial, aus Neuronalen Netze schädliche Werkzeuge oder sogar Waffen zu generieren.

Die heute verfügbaren Angriffswerkzeuge wurden noch von Menschen entwickelt, ganz ohne KI. Schon sie sind äußerst wirksam, wie Deutsche Forscher live auf der Bühne des BSI-Sicherheitskongresses demonstrierten. Das vor der Kongresshalle in Bonn-Bad Godesberg aufgenommene Foto eines Mannes mit Zeitung verwandelte ein Angriffstool in ein Bild, das von der KI als Foto eines Hundes identifiziert wurde. Wie genau der Angriff funktioniert, verraten die Mathematiker des Berliner Startups Neurocat nicht. Mit bloßen Auge sind die Manipulationen nicht zu entdecken. Ähnlich wie in dem bereits erwähnten Beispiel mit dem Pandabären werden die einzelnen Bildpunkte des digitalen Fotos so verändert, dass die Bilderkennung in die Irre geführt wird, nicht unbedingt die Anzahl der veränderten Pixel. Entscheidend ist die richtige Dosis aus Farb- und Helligkeitsveränderung. Man habe "Millionen" solcher Szenarien in Portfolio, so die Mathematiker von Neurocat. Nachdem in den USA immer mehr wissenschaftliche Veröffentlichungen die Schwachpunkte der KI beleuchteten, fanden sich vor zwei Jahren die Berliner Forscher zusammen, um auf eigene Faust nach Lösungen zu suchen. Eines dieser Ergebnisse ist ein Generator, der die Objekterkennung narrt. Nahezu beliebige Fehlerkennungen sind möglich. Objekte können aber auch verschwinden. Sie verschmelzen dann mit dem Hintergrund.

"Die Euphorie des KI-Hypes der letzten 10 Jahre ist teilweise der Ernüchterung gewichen", erläutert Neurocat Geschäftsführer Stephan Hinze. Rund um safety & security von autonom agierenden Apparaten und Geräten ist ein neuen Forschungsumfeld entstanden, das sich "robuste KI" nennt. Die Gemeinde der Forscher ist äußerst übersichtlich, und soll weltweit nicht mehr als 500 Personen umfassen, davon 50 Trendsetter.

„Das Finden von Gegenmaßnahmen ist aktuell eine internationale Challenge zwischen den Größen der KI Firmen“, erläutert Hinze. Seine Forscher diskutieren mit den Forschungsabteilungen von Internetgiganten wie Google. Die Wissenschaftler kennen sich von diversen Konferenzen. Umstritten ist, was gegen die Manipulationen zu tun sei. Ein Großteil der Forscher gehen davon aus, das einfach mehr Trainingsdaten zum Wissensschatz des Deep Learning Systems hinzugefügt werden müssen. Andere sehen das Skeptisch. Bei zu vielen Negativbeispielen, erkennt das Netz die Wirklichkeit nicht mehr korrekt. Andere wollen den Wissensschatz, das tiefe Netz, durch Eingaben direkt verändern, andere konstruieren Schutzmodule aus Software, die Störungen aus dem Datenfluss entfernen, noch bevor dieser das Neuronale Netz erreicht.

Transparenz gegen „vergiftete“ Daten

Welche Lösung seine Firma vorschlagen wird, möchte Stephan Hinze noch nicht verraten. Er verweist auf kommende Veröffentlichungen und Patentgesuche. Aber er verrät: „Sicherheitsrisiken liegen nicht nur in den Algorithmen, sondern zusätzlich auch in den Daten“. Damit liegt er auf der Linie von ANSSI, BSI und dem Bundesdatenschutzbeauftragten. Alle Behörden verlangen, dass die zwingend notwendigen Trainingsdaten transparenter und nachvollziehbarer Herkunft sein müssen. Denn “vergiftete” Daten könnten zu unerwünschten Modellen führen. Während die einen um Safety und Security bangen, befürchten die anderen Nachteile für religiöse und politische Gruppierungen. Sie könnten diskriminiert werden. Mögliche Diskriminierungen sind auch Arbeitsgebiet der Enquete Kommission "Künstliche Intelligenz" des Deutschen Bundestages.

Die Ursachen der Probleme liegt tief verborgen in den Millionen von Parametern, dem Wissensspeicher des Deep Learnings. Mathematisch ein hochdimensionales mathematisches Optimierungsproblem. Für die IT ein Spiel mit neuen Regeln. Denn wie man schädliche Instruktionen in einem Sourcecode (Quellcode) findet, ist Informatikern zumindest theoretisch gut bekannt. Wie bei der Sicherheitsüberprüfung eines Neuronalen Netzes mit Deep Learning vorzugehen ist, darüber grübeln noch die Experten. „KI Qualität kann nicht allein mit einer Quelltextsichtung durch Experten beurteilt werden. Hierfür benötigen Experten neue Prüfsoftware, die die Daten und komplexen KI Modelle analysieren“, meint Stephan Hinze. Diverse Teams arbeiten an solchen Prüfverfahren. Angesicht der hohen Geschwindigkeit, mit der KI in die Gesellschaft vordringt, eine zunehmend drängende Aufgabe.

(ID:46029465)

:quality(80)/p7i.vogel.de/wcms/77/96/77965e389847a783a89d16ec537bbdfd/0127091202v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8a/d7/8ad77a356a43b3c02e85ce72e1f6c2c3/0127092578v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d7/14/d714ac0a936f45496f02ffb57415bef2/0127092564v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/1b/8c/1b8c9daac953cdc1626e92fc5b1dbef6/0122470970v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6a/b5/6ab598d2e83ca9d83405cefb4a159a39/0131691458v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/42/69/4269999773d4d413fa17a36ece8ae43a/0131174875v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/06/5e/065e92af5e901aebe20227cc6ff5ede5/0131694546v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/aa/8d/aa8da96123055f62a20b360a8d395663/0131669958v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/cb/40/cb407c88e468ea328316eacf9989bf51/0131691124v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/52/aa/52aa56cfa8429500aed9c345cb3b5b26/0131021993v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/82/83/8283d1d700e0582909b74705cc6c4e28/0131665494v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/d3/7d/d37da587e71df94e386d637359e2dd20/0131661753v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/0e/77/0e7755d3244b65ac9dcf77251d1f5246/0131519002v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b8/e8/b8e8b6218eb7be40fe2a3a80cb992a2d/0131667121v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e2/96/e2964b14fad79c176076050c1c3fb7c8/0131694920v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/93/eb/93eb3147fbb7a93702638c0baa15aa5d/0131538616v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/38/73/38736859f3bbd53b9fc6edcc8f372f1a/0131559499v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/dc/e7/dce7048477ac2b6f9d1411475c2fef78/0131183563v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a3/7d/a37d1d1261dbe550bbc86876a966b983/0131028980v1.jpeg)

:quality(80)/images.vogel.de/vogelonline/bdb/1804200/1804272/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1804200/1804284/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1801500/1801554/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1801500/1801534/original.jpg)

:fill(fff,0)/p7i.vogel.de/companies/68/2d/682dd583dcc4c/fsas-afc-horizontal-2-positive-rgb-nov24.png)

:fill(fff,0)/p7i.vogel.de/companies/63/db/63dbd1915b7af/2023-fastlta-logo-square-positive.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/67/f6/67f625705f340/ftapi-logo.jpeg)

:quality(80)/p7i.vogel.de/wcms/c4/52/c4526444911a1e496bc113813291c6be/0130586130v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/62/1f/621ff43122a7392087d8728dcf07e18b/0125957150v1.jpeg)